日前,顶级深度学习攻防对抗大赛:IJCAI-19阿里巴巴人工智能对抗算法竞赛复赛成绩揭晓,中国科大网络空间安全学院学生战队(RNG队与红小豆队)在全球2500多支战队中脱颖而出,获得佳绩。其中RNG队获得模型防御项目第一名!无目标攻击项目和有目标攻击项目中分列第二和第四,是所有参赛队伍中综合成绩最好的队伍。红小豆队在则模型防御与无目标攻击中分别取得了第四和第十二名的优秀成绩。

近年,中国科大网络空间安全学院鼓励学生在学习之余积极参加国内外顶级网安类权威比赛,先后参加了“信息安全铁人三项赛”、“全国大学生信息安全竞赛”、"谷歌大脑全球算法大赛"等比赛。虽然缺乏经验积累,但是凭借极强的学习能力,辅一亮相即取得不俗成绩。

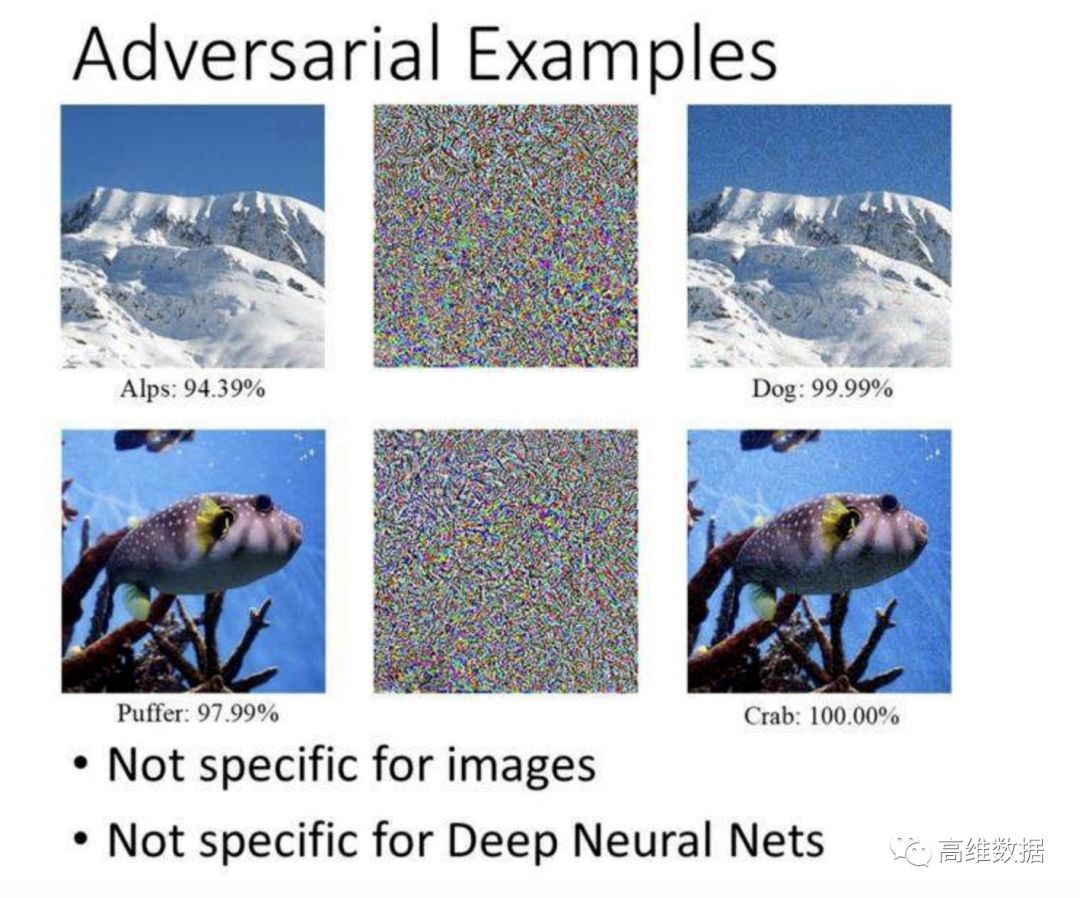

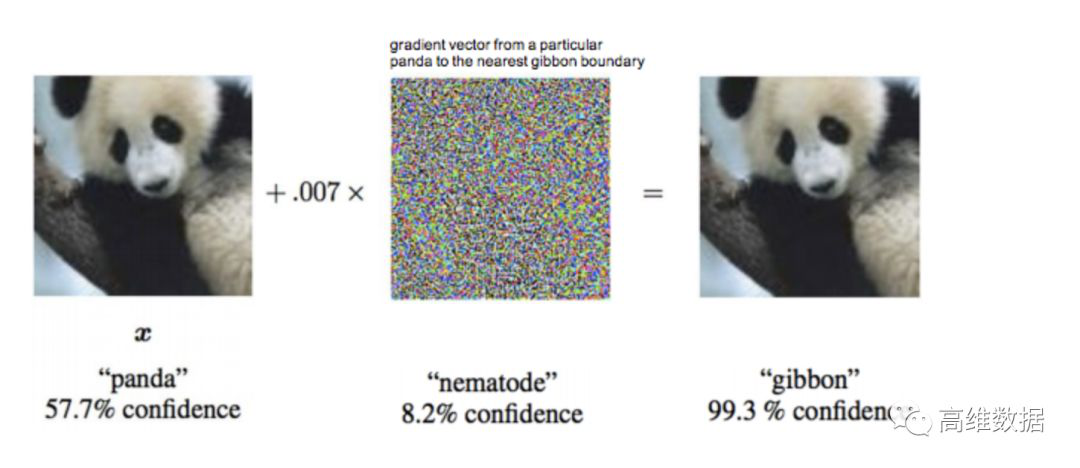

近年来深度学习技术的不断突破,极大促进了人工智能行业的发展,而人工智能模型本身的安全问题,也日益受到AI从业人员的关注,2014年行业首次提出针对图像的对抗样本的概念,并用实验结果展示了深度学习模型在安全方面的局限性。通过对原始样本有针对性的加入微小扰动来构造对抗样本,该扰动不易被人眼所察觉,但会导致AI模型识别错误,这种攻击被称为“对抗攻击“,也是目前深度学习领域最热的研究课题之一。在这一背景下,由阿里巴巴集团旗下阿里安全集团、阿里天池大数据平台和人工智能领域国际顶会IJCAI等单位共同举办了首届阿里巴巴人工智能对抗算法竞赛。

活动凭借强大的影响力、权威性和锻炼机会得到国内外关注人工智能安全的大学及企业组织的关注,吸引了来自世界各地超过2500个战队报名参赛。

中国科学技术大学网络空间安全学院也积极鼓励关注相关领域研究的团队参加。其中信息隐藏课题组长期从事多媒体安全与深度学习攻防对抗方面的研究,其中人工智能安全是课题组所重点关注的研究方向之一。在学院领导与课题组指导老师的支持与鼓励下,来自网络空间安全学院信息隐藏课题组的多位学生自由组队,参加了本次比赛。

本次赛事主题为深度学习对抗样本技术攻防,围绕对抗样本技术这一近年来受到广泛关注的深度学习热点问题展开。“对抗样本”的概念由Szegedy等人在2014年首次提出,通过对原始样本(如图片)有针对性的加入微小扰动来构造对抗样本,导致深度学习模型识别错误。本次比赛共分为无目标攻击(使目标图片被错判为正确类别之外的其他类)、有目标攻击(使目标图片被错判为正确类别之外的指定类)和模型防御(将对抗样本图片进行正确分类)三项内容,来自世界各地的2500支队伍分项参赛。

比赛分为初赛与复赛两个阶段,历时三个月,最终由俞能海教授、张卫明教授共同指导的RNG队与红小豆队通过激烈角逐,分别取得了优异成绩。其中,RNG队在模型防御项目中摘得桂冠!无目标和有目标攻击项目中分列第二和第四,也是所有参赛队伍中综合成绩最好的队伍。红小豆队在则模型防御与无目标攻击中分别取得了第四和第十二名的优秀成绩。

无目标攻击成绩

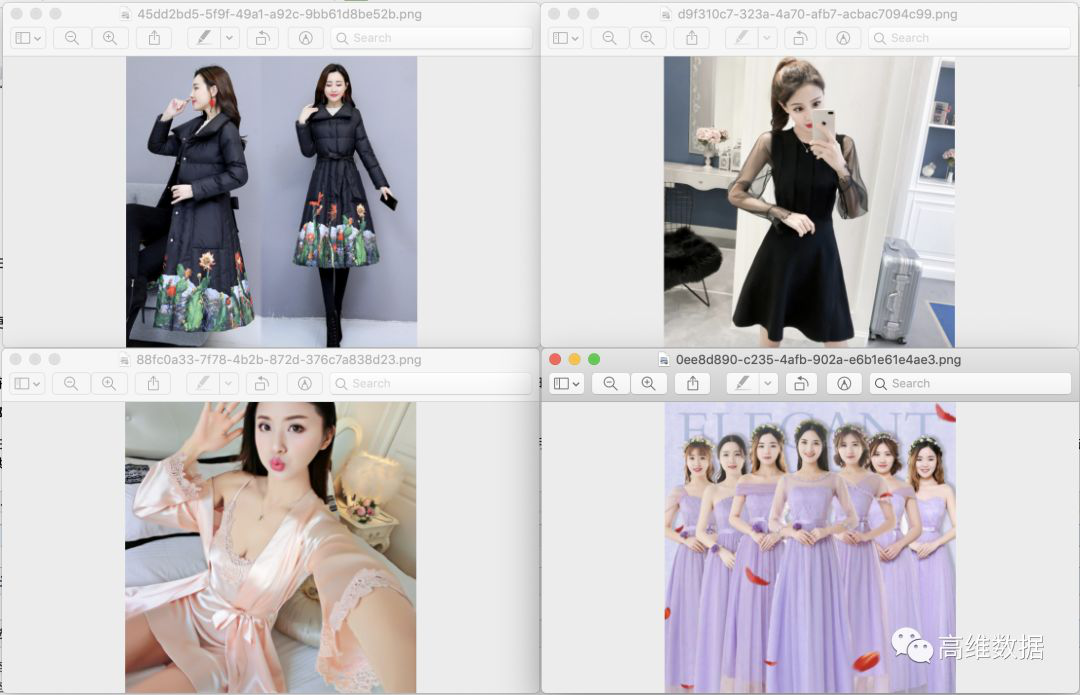

当前的对抗样本技术仍处于学术研究阶段,为了让该项技术能够有效应用于实际场景,本次比赛采用了阿里巴巴电商平台的商品图片作为数据集。主办方提供了11万张商品图片作为训练集,共包含110个类别,并使用数百张图片作为评测数据。其中无目标攻击不指定具体类别,只要让模型识别错误即可,同时扰动越小越好。有目标攻击比无目标攻击更加困难,不仅需要使模型识别错误,还需要使模型将图片识别到指定的类别,同时扰动越小越好。模型防御则需要选手提供更加鲁棒的防御模型,能够正确识别对抗样本,同时处理的扰动越大越好。这样的规则决定了参赛选手必须采用注重实际的策略,需要针对电商图片的特点进行对抗样本的攻防,并考虑到其他对手可能采用的防御手段而进行针对性攻击,这俨然是一场模拟的网络攻防战!

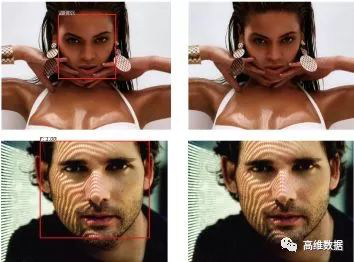

下图所示图片为RNG小队无目标攻击方法的实际效果图,左图为原始商品图片,右图为经过修改后的对抗样本图片。可以看到二者在视觉效果上几乎无差异,这反映出我们所采用的方法在实现攻击的同时所进行的修改量是很小的。比赛采用的攻防算法将在赛事答辩完成后公布。

图: 无目标攻击示例图

经过不断的模拟攻防与方法改进,本次参赛的两支队伍在取得优秀的成绩的同时积累了宝贵的经验,并获得了前往IJCAI2019的举办地—澳门参加现场答辩的机会。